TL;DR — Un audit SEO de blog ou de site web, ça prend plusieurs jours manuellement et coûte des milliers d'euros en agence. Avec Claude Code connecté à Google Analytics 4 et Google Search Console via deux MCP, j'ai obtenu un audit complet de 241 URLs en moins de 2 heures. Avec des résultats concrets comme un article passé de la 3e page à la 1ère position sur Google, un autre remonté de la page 4 à la page 2. Voici comment j'ai fait, étape par étape.

Tu publies régulièrement et tu passes du temps à rédiger, à optimiser, à diffuser. Et pourtant, ton trafic ne décolle pas vraiment. Les leads n'arrivent pas. Le chiffre d'affaires stagne. Et si tu divises le temps passé sur chaque article par le nombre de visites qu'il génère, le coût au contenu devient franchement déprimant.

C'est le scénario que beaucoup d'entreprises et freelances connaissent sans oser se l'avouer. Publier pour publier, sans jamais regarder ce qui se passe sous le capot, est contre-productif. Regarder sous le capot, c'est accepter que beaucoup de ce travail est peut-être en train de te travailler contre toi !

Moins de trafic, c'est moins de leads entrants. Moins de leads, c'est moins de revenus. Et pendant ce temps, le coût de production de chaque contenu grimpe, parce que tu produis sur des fondements qui fuient.

J'ai vécu ça, j'avais accumulé des années de contenu sans jamais vraiment faire le ménage. Et puis j'ai connecté Claude Code à Google Analytics et Google Search Console. En moins de 2 heures, il m'a sorti un audit SEO complet que j'aurais vendu plusieurs milliers d'euros quand j'avais encore mon agence. 😅

Pourquoi un audit SEO de ton blog ou de ton site web est indispensable ?

Si tu as un blog ou un site actif depuis plus de deux ans, tu accumules de la dette technique et éditoriale sans t'en rendre compte. Des articles écrits en 2022 qui parlent de tendances révolues. Des doublons créés par accident. Des pages AMP indexées par Google qui n'existent plus vraiment. Des URLs cassées qui dorment tranquillement en page 5, pompant du PageRank sans jamais rien ramener.

La même logique s'applique à un site vitrine ou un site e-commerce. Des pages produits orphelines, des catégories vides, des fiches dupliquées, des URLs mal structurées qui se canibalisent mutuellement. Google crawle tout ça, il note tout ça, et il en tient compte dans le score global qu'il attribue à ton domaine.

Google ne te prévient pas quand ton site commence à perdre pied. Il baisse simplement tes positions, progressivement, jusqu'à ce que tu remarques que ton trafic organique stagne alors que tu continues de publier ou de mettre à jour.

Un audit de contenu, c'est le bilan de santé que tu repousses depuis trop longtemps. Il te dit précisément quels contenus méritent d'être renforcés, lesquels doivent fusionner, et lesquels sont à supprimer avec une redirection 301 propre.

Avant l'IA, c'était le travail le plus ingrat du SEO

Quand je dirigeais mon agence, je ne faisais pas les audits moi-même. Je les déléguais à mon spécialiste SEO. Pas par manque d'intérêt, mais parce que ça nécessitait un niveau de rigueur méthodique que je n'avais pas, et des bases techniques solides que j'aurais mis des semaines à acquérir correctement.

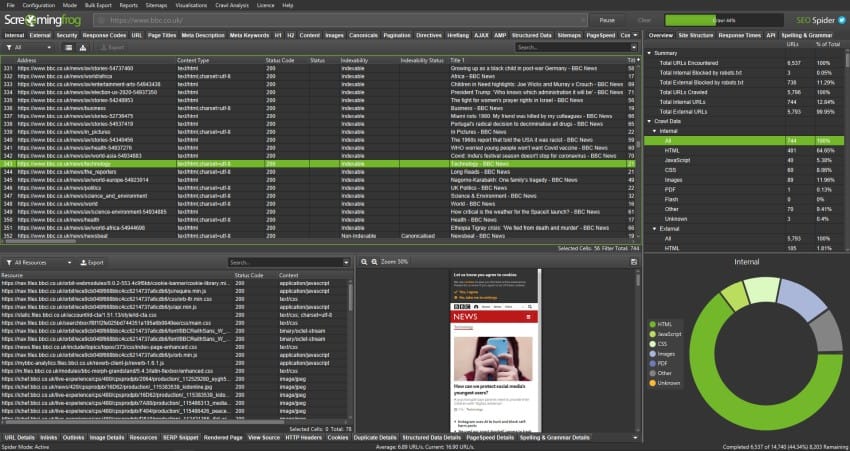

Le process, tel qu'il le pratiquait, ressemblait à ça : exporter les données GA, les croiser avec la GSC, plonger dans Screaming Frog pour crawler les URLs, catégoriser article par article, identifier les canibalisations de mots-clés, les redirections manquantes, les pages zombies. C'est facile à résumer, mais très long à faire. Plusieurs jours de travail concentré, avec des tableaux croisés dynamiques que je n'aurais pas su construire par manque de rigueur.

On facturait ce genre de prestation entre 3 500 euros pour les petits sites web et plus de 10 000 euros pour les plus gros. Et c'était honnête, le travail le justifiait amplement.

Le problème, c'est qu'une fois l'audit terminé, il était déjà partiellement obsolète. Le blog continuait de grossir, de nouveaux doublons apparaissaient, et les données de trafic évoluaient. L'audit était une photo. La réalité bougeait vite et les correctifs à apporter suite à l'audit étaient souvent longs à mettre en œuvre.

Bref, c'était un travail fastidieux et relativement frustrant, car souvent peu suivi d'effet.

Mais je me suis dit qu'avec l'IA, l'audit de site web ou de blog devait être un parfait terrain de jeu. Et c'est le cas puisque l'audit SEO de mon blog a été réalisé en moins d'une demi-journée et les correctifs sont beaucoup plus rapides à mettre en œuvre grâce à l'IA.

Les deux MCP qui connectent Claude Code à tes données SEO

Avant de détailler le process, un point technique important : Claude Code communique avec des sources de données externes via des MCP (Model Context Protocol). Ce sont des connecteurs qui permettent à Claude Code d'interroger directement des APIs, des bases de données ou des outils tiers, sans avoir à passer par des exports manuels fastidieux.

Si tu veux en savoir plus sur les MCP, j'ai publié un article : "Les Meilleurs MCP pour Claude : la Liste Complète par Catégorie (2026)"

Pour cet audit SEO, j'en ai installé deux.

Le MCP Google Analytics 4 (officiel)

Google a publié un MCP officiel pour Analytics. Il est disponible directement dans la documentation Google. Une fois configuré avec tes identifiants OAuth, Claude Code peut accéder à toutes tes propriétés GA4 et interroger directement l'API : sessions, pages vues, taux de rebond, durée de session, sources de trafic, par page et par période.

Concrètement, ça veut dire que Claude Code peut répondre à des questions comme "quels sont mes 20 articles avec le plus de sessions sur les 12 derniers mois ?" et obtenir le résultat structuré en quelques secondes, sans que tu aies à toucher à une seule cellule de tableur.

Le MCP Google Search Console (communautaire)

Pour la GSC, j'ai utilisé le MCP développé par Amin Forou, disponible sur GitHub. Ce n'est pas un MCP officiel Google, c'est un projet open source communautaire. Il est néanmoins très bien documenté et fonctionne de façon fiable. Il se connecte à l'API Search Console via les identifiants Google Cloud et permet d'interroger les données de performance : impressions, clics, CTR, position moyenne, par URL, par requête, par pays, sur n'importe quelle période.

Ce setup permet de croiser en temps réel "combien de fois cette page est-elle apparue dans les résultats Google ?" avec "combien de visites elle a reçues dans GA4 ?" C'est ce croisement qui révèle les vrais problèmes de visibilité organique.

Comment j'ai fait l'audit SEO avec Claude Code ?

Cela faisait longtemps que je voulais faire ce foutu audit. J'ai donc pris le taureau par les cornes pour tester Claude Code sur un cas concret. Ce n'était pas une démo, je voulais réellement auditer mon blog, avec 160 articles publiés, des années de contenus empilés sans aucune stratégie de nettoyage. D'ailleurs, initialement, je ne pensais absolument pas à rédiger cet article. L'idée m'est venue après avoir constaté les premiers bénéfices.

Si tu veux un cours complet sur Claude Code, je te conseille cette vidéo de plus de 4h !!

Étape 1 : connexion aux sources de données

Une fois les deux MCP installés et configurés, j'ai connecté Claude Code à ma propriété Google Analytics 4 et à ma Google Search Console. Période d'analyse : 12 mois, du 1er avril 2025 au 31 mars 2026.

J'ai aussi fait un export JSON complet du blog Ghost. C'est une fonctionnalité native (Settings → Labs → Export your content) qui donne accès à la structure complète du site : articles publiés, drafts, slugs, tags, dates de publication. Claude Code avait donc une vision complète et exhaustive du blog.

Étape 2 : le croisement des données

C'est là où Claude Code fait quelque chose qu'aucun humain ne ferait avec plaisir (enfin, sauf s'il est maso 😂) : croiser trois sources différentes, avec des formats incompatibles, pour en extraire des signaux utiles.

GA4 utilise les URLs en captain-marketing.ghost.io. GSC utilise blog.captainmarketing.io. C'est le même contenu, des slugs identiques, mais deux domaines différents en apparence. Aligner les données manuellement est un calvaire. Claude m'a sauvé la vie en normalisant et fusionnant toutes ces données en quelques secondes.

Étape 3 : la génération de l'audit

C'est là qu'on voit concrètement ce que Claude Code fait différemment d'un chatbot classique. Tu ne lui soumets pas une question, tu lui donnes une mission. Voici le prompt que j'ai utilisé pour générer le premier rapport :

Récupère les données de trafic de ma propriété captain-marketing.ghost.io

sur les 12 derniers mois. Classe les pages par nombre de sessions décroissant.

Identifie les articles qui ont moins de 50 sessions sur la période.

Génère un fichier audit-blog.md dans le dossier audit-blog-captain avec

trois sections : articles performants (top 20), articles à optimiser

(trafic faible mais impressions élevées), articles à retirer ou fusionner

(trafic quasi nul).

Claude Code interroge l'API GA, analyse les données, écrit le fichier dans ton dossier local. Pas d'export CSV, pas de tableur, pas de copier-coller. Une instruction, un fichier.

Ensuite, une fois le MCP Search Console connecté, j'ai envoyé un deuxième prompt pour croiser les deux sources :

En te basant sur le fichier audit-blog.md déjà présent dans le dossier,

confirme ou infirme les conclusions GA avec les données Google Search Console

de captain-marketing.ghost.io. Pour chaque article listé, ajoute les clics,

impressions, CTR et position moyenne GSC. Signale les écarts significatifs

entre les deux sources et mets à jour le rapport.

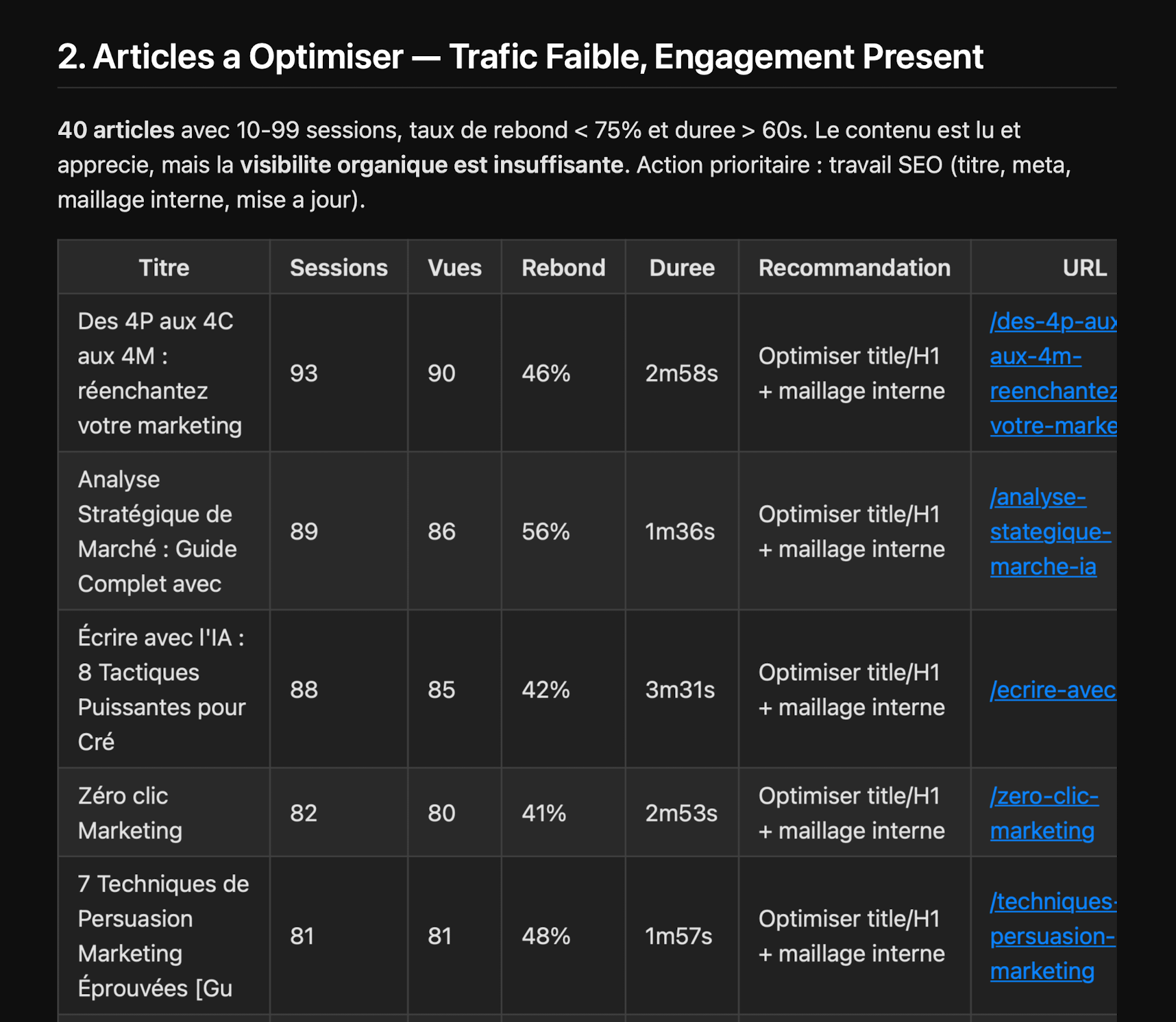

Après avoir réconcilié les données, Claude Code a structuré l'audit en quatre blocs :

- Les articles performants (Top 20)

- Les articles à potentiel sous-exploité

- Les articles à supprimer ou fusionner

- Le croisement GA4 / GSC pour identifier les écarts entre trafic réel et visibilité organique

Chaque URL a été analysée individuellement avec ses sessions GA4, ses clics GSC, ses impressions, son CTR, sa position moyenne, son taux de rebond et sa durée de session.

Ce que l'audit SEO a révélé

Les résultats sont à la fois rassurants et inconfortables. Rassurants parce que 20 articles génèrent 60% du trafic total. Inconfortables parce que 124 pages génèrent moins de 10 sessions et diluent le PageRank de l'ensemble.

Les "faux performants" : ce sont les articles qui semblent bien fonctionner dans GA4 mais n'ont aucune visibilité sur Google. L'article sur le Job To Be Done affiche 716 sessions dans GA4, mais seulement 17 clics dans GSC. Ratio de 42x. Ce trafic vient entièrement de la newsletter et de LinkedIn. Une fois la promotion de l'article terminée, il perd son audience du jour au lendemain. Aucune rente SEO ne le protège.

Les opportunités cachées : ce sont les articles avec beaucoup d'impressions Google mais un positionnement trop profond pour générer des clics. L'article sur la création de contenu cumule 91 823 impressions sur 12 mois pour seulement 149 clics, soit un CTR de 0.16%. Il est bloqué en position 34, à la limite de la page 4. Une remontée en première page pourrait générer entre 800 et 1 200 clics supplémentaires par mois.

Les pages zombies AMP : Ghost avait généré automatiquement des versions AMP de certains articles. Ces URLs ont été indexées par Google. Résultat : des dizaines de pages avec 100% de taux de rebond et 0 à 6 secondes de durée de session. Du bruit pur qui pollue le signal envoyé à Google. AMP est un format abandonné par Google depuis 2021.

Les recommandations concrètes portaient sur trois axes :

- Redirections 301 prioritaires, notamment pour les pages AMP, les articles supprimés sans redirection, et les URLs cassées (typos, parenthèses orphelines, slugs brisés).

- Fusion de doublons, en particulier autour du cluster "persona marketing" où quatre articles traitaient du même sujet à des niveaux de qualité inégaux.

- Travail SEO on-page sur les articles à fort potentiel d'impressions bloquées.

Les résultats : ce que l'audit a concrètement changé

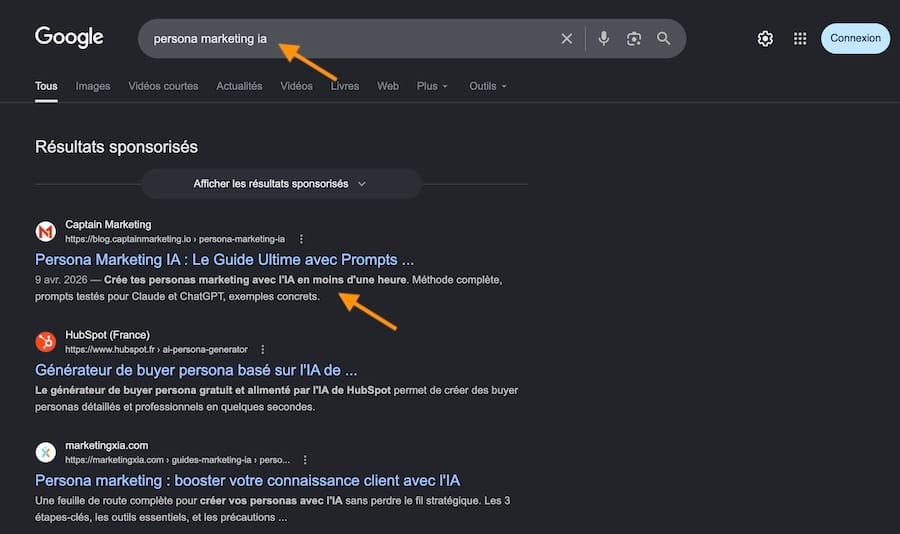

J'ai commencé par l'article le plus évident : le guide Persona Marketing IA, bloqué en position 36 avec 29 297 impressions. L'audit était clair : le potentiel était là, le positionnement ne suivait pas.

Refonte du H1, enrichissement du contenu, renforcement du maillage interne depuis les articles les plus visités, fusion de plusieurs articles sur le même sujet. L'article est passé de la 3e page Google à la 1ère position. C'est maintenant l'un des articles les plus visibles du blog sur sa requête cible.

Deuxième chantier : l'article Création de contenu, celui aux 91 823 impressions bloquées en position 34. Même approche. Les résultats sont en cours : l'article est remonté du fin fond de la 3e page en haut de la 2e page. L'optimisation continue pour viser la première page.

Ce sont deux cas concrets, sur deux articles traités en priorité. L'audit liste encore une quarantaine d'articles à travailler, plus 124 pages à nettoyer. J'ai encore du boulot. 😅

Pour information, l'audit fait plus de 31 pages !

Ce que ça change vraiment

Ce qui m'a frappé, ce n'est pas la puissance de l'outil en tant que tel. C'est la vitesse à laquelle j'ai eu une vision claire de l'état réel de mon blog, quelque chose que j'aurais continué à repousser indéfiniment si l'IA n'était pas là.

L'audit a été généré en moins de 2 heures, setup tech compris. Le rapport est structuré, priorisé, actionnable. Des recommandations numérotées par ordre d'impact, des estimations de trafic potentiel par article, une liste de redirections prêtes à copier-coller dans Ghost.

Claude Code ne remplace pas un regard humain sur le fond éditorial, mais pour l'analyse de trafic, l'identification des pages zombies, le croisement GA4 / GSC et la priorisation des chantiers SEO, c'est un outil qui rend accessible quelque chose qui était jusqu'ici réservé aux agences et aux équipes avec un SEO dédié.

Si tu as un blog ou un site actif depuis plus de 18 mois et que tu n'as jamais fait d'audit SEO sérieux, tu as probablement des dizaines de pages qui travaillent contre toi. Cette semaine, exporte ton contenu depuis ton CMS et connecte Claude Code à tes données Analytics. Le rapport que tu vas obtenir va t'occuper pendant quelques semaines.

Et si tu souhaites de l'aide, n'hésite pas à prendre RDV directement dans mon agenda :

Et si tu souhaites de l'aide, n'hésite pas à prendre RDV directement dans mon agenda :

Questions fréquentes sur l'audit SEO avec Claude Code

Claude Code peut-il auditer n'importe quel type de site ?

Oui. La méthode fonctionne pour un blog, un site vitrine, un site e-commerce ou tout site dont tu peux connecter les données GA4 et GSC à Claude Code via les MCP décrits dans cet article.

Faut-il être développeur pour utiliser Claude Code ?

Non. L'installation des MCP demande quelques minutes de configuration (identifiants OAuth, clé API Google Cloud), mais aucune compétence en développement n'est requise. La documentation de chaque MCP est claire et guidée.

Combien de temps prend un audit SEO complet avec Claude Code ?

Entre 1 et 3 heures selon la taille du site et le volume de données à croiser. C'est sans commune mesure avec les plusieurs jours qu'un audit manuel nécessitait.

Est-ce que Claude Code remplace un consultant SEO ?

Pour l'analyse des données de performance et la priorisation des chantiers, oui, en grande partie. Pour la stratégie éditoriale de fond, l'analyse concurrentielle approfondie et le travail sémantique sur chaque article, un regard humain reste nécessaire.